Угроза для Искусственного Интеллекта: Почему «Гниение Мозга» ИИ и «Теория Мертвого Интернета» могут остановить прогресс

- Категория: AI Технологии

- Дата: 22 октября 2025 г. в 14:31

- Просмотров: 245

Генеративный искусственный интеллект (ИИ) плотно вошел в нашу жизнь, став неотъемлемой частью вычислений, образования, медицины и многих других областей. Сегодняшние модели прошли долгий путь от ранних этапов, когда они часто "галлюцинировали" и выдавали абсолютно неверные ответы.

Как вы, вероятно, знаете, ведущие ИИ-лаборатории, такие как Anthropic, OpenAI и Google, обучают свои Большие Языковые Модели (LLM) на огромном количестве данных, которые мы, люди, публикуем в интернете. Однако уже в прошлом году эксперты забили тревогу: компании столкнулись с кризисом — нехваткой высококачественного контента для тренировки продвинутых ИИ.

И, похоже, эти проблемы только усугубляются. Согласно новому исследованию Корнельского университета, LLM могут страдать от настоящего "гниения мозга" (brain rot) из-за длительного воздействия низкокачественных данных из Сети. Ученые утверждают, что это существенно снижает их когнитивные способности.

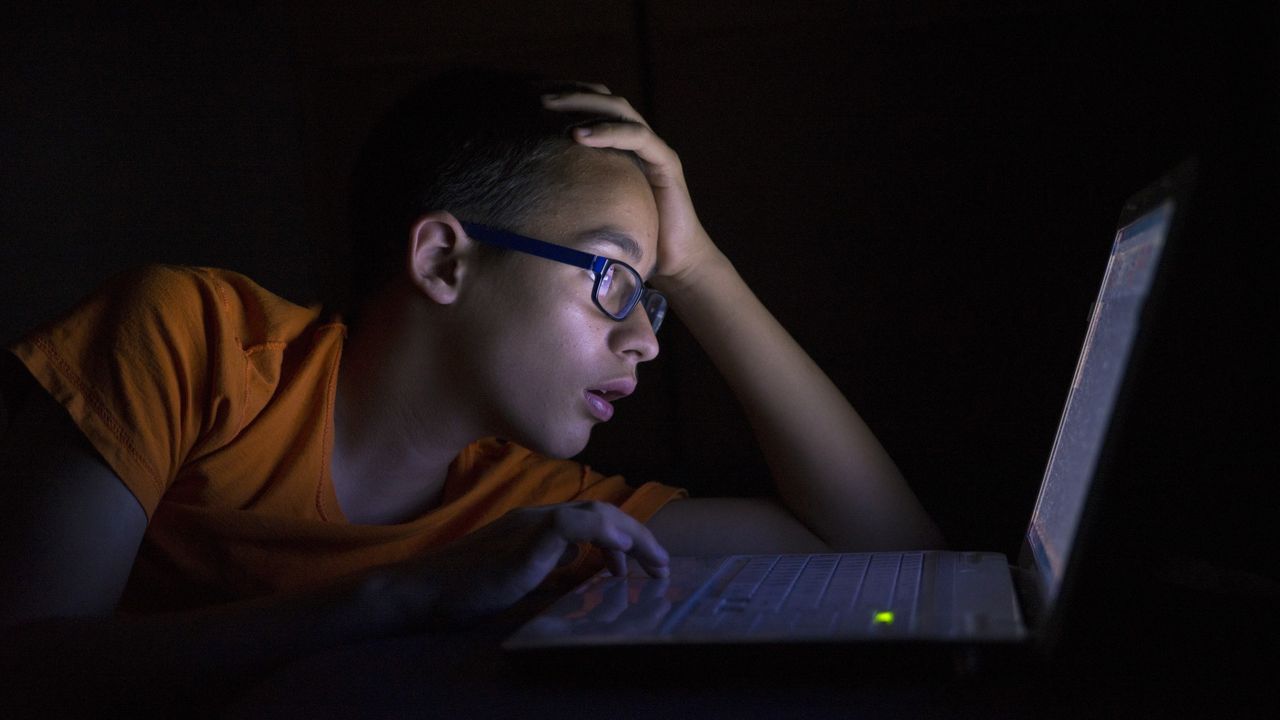

Что такое "гниение мозга"? Изначально этот термин описывал эффект, когда постоянное потребление тривиального и низкокачественного онлайн-контента негативно сказывается на способности человека к рассуждению и концентрации. Оказывается, то же самое происходит и с ИИ-моделями!

Почему ИИ начинает глупеть? Методология исследования

Чтобы определить, что именно вызывает деградацию, исследователи придумали два способа оценки "мусорного" интернет-контента.

- "Вирусный" мусор: фокусировался на коротких, вирусных постах с высоким охватом (по сути, инфошум).

- Семантический мусор: оценивал низкое качество контента, изобилующего кликбейтом и поверхностностью.

Далее ученые использовали эти данные для создания обучающих наборов, в которых были смешаны "мусорный" и качественный контент в разных пропорциях. Эти наборы были использованы для обучения популярных LLM, таких как Llama 3 и Qwen 2.5.

Главная цель состояла в том, чтобы понять, как будет развиваться ИИ-система, если она постоянно полагается на низкокачественный, вирусный, или что еще хуже, сгенерированный машинами контент, который сейчас наводнил интернет.

Катастрофа точности: Результаты "гниения мозга"

Результаты исследования оказались тревожными.

- Падение точности: Точность ИИ-моделей, обученных исключительно на "мусорном" контенте, упала с 74,9% до 57,2%.

- Снижение понимания: Способности ИИ к пониманию длинных текстов и контекста снизились с 84,4% до 52,3%.

Исследователи обнаружили "эффект дозы": чем дольше ИИ подвергался воздействию некачественного контента, тем сильнее снижались его когнитивные способности и возможности к пониманию.

Кроме того, длительное воздействие низкокачественных данных негативно повлияло на этическую согласованность моделей, вызывая "смещение личности". Модели стали чаще ошибаться, что сделало их менее надежными для пользователей. Влияние "мусорных" данных также нарушило логику моделей, заставляя их пропускать пошаговые рассуждения и генерировать лишь поверхностные ответы.

Сэм Альтман и соучредитель Reddit утверждают, что значительная часть интернета уже мертва из-за растущего количества ботов и ИИ. (Фото: Getty Images | Bloomberg)

"Теория Мертвого Интернета" перестает быть теорией

Эта научная работа перекликается с опасениями, которые уже давно высказывают ключевые фигуры в мире технологий. "Теория Мертвого Интернета" — предположение о том, что большая часть контента в Сети создается не людьми, а ботами или ИИ — становится горькой реальностью в эпоху генеративного ИИ.

Так, соучредитель Reddit Алексис Оганян и генеральный директор OpenAI Сэм Альтман публично обсуждали эту проблему:

Вы все видите, что огромная часть интернета уже мертва — это и есть теория мертвого интернета, верно? Будь это боты, будь это квази-ИИ, или "слив" в LinkedIn. Наличие доказательств жизни, например, живые зрители и живой контент, будет невероятно ценно для удержания внимания.

— Алексис Оганян, соучредитель Reddit

Глава OpenAI, Сэм Альтман, разделяет это мнение, предполагая, что большинство аккаунтов в соцсети X (бывший Twitter) уже управляются LLM.

Статистика подтверждает эти опасения. В прошлом году исследование Amazon Web Services (AWS) показало, что 57% контента, публикуемого в Сети, уже был либо сгенерирован, либо существенно изменен ИИ-алгоритмами. Такое количество синтетического контента неизбежно снижает качество поисковых результатов для людей.

Даже бывший генеральный директор Twitter Джек Дорси предупредил:

В следующие 5-10 лет мы не сможем отличить реальное от поддельного, из-за того как создаются дипфейки и фейковые видео. Пользователям придется быть постоянно бдительными и самим искать доказательства подлинности информации.

Что это значит для нас?

Если ИИ-модели, которые должны помогать нам, обучаются на низкокачественном мусоре, они сами становятся некомпетентными. Это не просто академическая проблема; это угроза для будущего развития технологий, которые мы планируем использовать для принятия важных решений — от медицины до управления инфраструктурой.

Если ИИ будет лишь воспроизводить ошибки и поверхностность, почерпнутые из "мертвого интернета", его способность к инновациям и надежному анализу будет парализована. Необходимо срочно разработать механизмы фильтрации и оценки качества контента, а также искать новые пути для обучения ИИ, чтобы он продолжал развиваться, а не "гнил". Иначе мы рискуем оказаться в мире, где ИИ, вместо того чтобы быть двигателем прогресса, станет лишь усилителем самых низкопробных аспектов онлайн-жизни.

- Комментарии