OpenAI под огнем: Отток пользователей ChatGPT и скандал с Пентагоном

- Категория: AI Технологии

- Дата: 3 марта 2026 г. в 20:31

- Просмотров: 123

Что ж, ребята, похоже, у OpenAI не самые лучшие времена. 😬 Рассказываю, как есть:

Последние новости вокруг OpenAI и их флагманского продукта ChatGPT в последнее время вызывают бурное обсуждение. Кажется, что вслед за взрывным ростом популярности, компания столкнулась и со столь же резким негативом.

](https://www.reddit.com/r/windowscentral/)Join us on Reddit at r/WindowsCentral to share your insights and discuss our latest news, reviews, and more.

Пользователи уходят, критики наступают 📉

Появилась информация о том, что количество удалений ChatGPT подскочило на целых 295%! 😱 Это серьезный сигнал, особенно когда речь идет о таком популярном продукте.

Судя по всему, это связано с неоднозначной сделкой OpenAI с Пентагоном. В то время как Anthropic, другая ИИ-компания, отказалась от контракта из-за опасений по поводу использования своих моделей для массовой слежки и автономного оружия, OpenAI, похоже, согласилась. Это вызвало волну критики и привело к тому, что некоторые пользователи стали удалять ChatGPT, а хэштеги вроде "Cancel ChatGPT" и "QuitGPT" стали вирусными. 🙅♂️

Скандал с Пентагоном: "Оппортунистично и небрежно" 🤦♂️

OpenAI заключила соглашение с Министерством обороны США, позволяющее использовать их ИИ-технологии в секретных системах. Однако, когда стало известно, что это может включать в себя военное применение, люди начали волноваться.

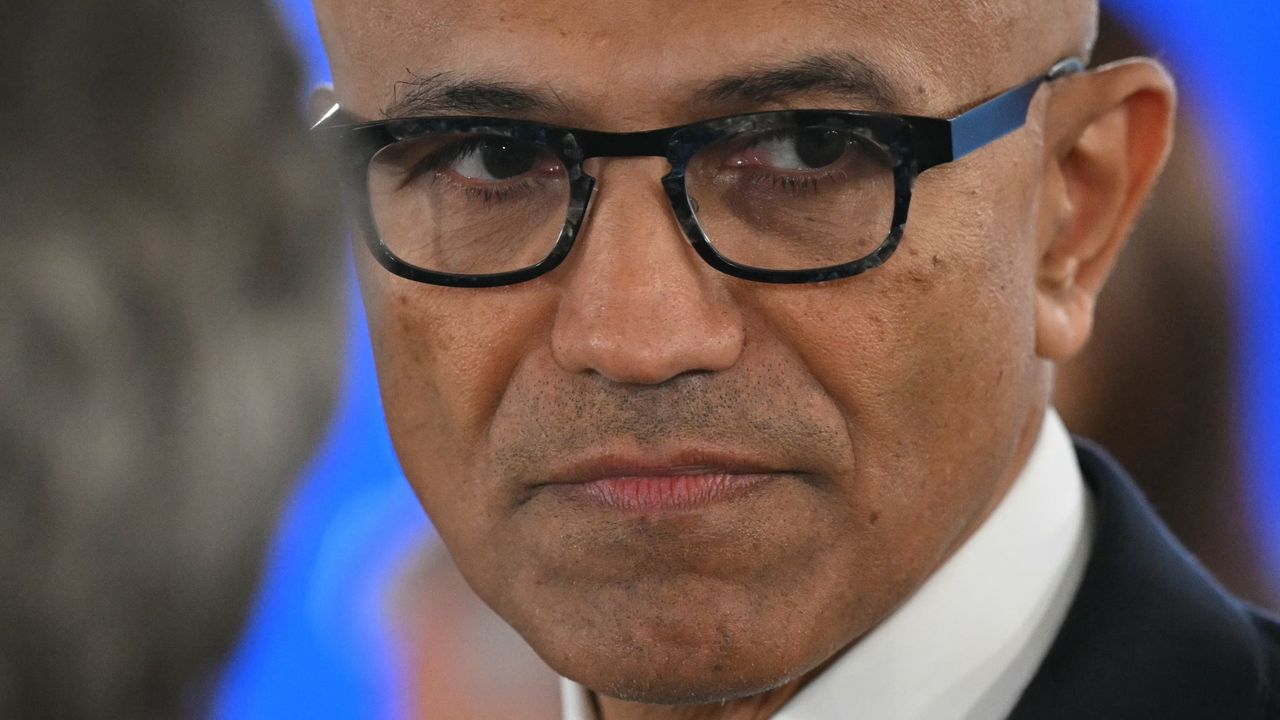

Проблемы очень сложные, и требуют четкой коммуникации. Мы искренне пытались деэскалировать ситуацию и избежать гораздо худшего исхода, но, думаю, выглядело это оппортунистично и небрежно.

Сэм Альтман, генеральный директор OpenAI

Сам Сэм Альтман признался, что компания, возможно, поторопилась с этой сделкой. Он заявил, что OpenAI планирует внести поправки в контракт, чтобы четко прописать, что "система ИИ не будет намеренно использоваться для внутренней слежки за гражданами США". Он также подчеркнул, что некоторые вещи, на которые ИИ пока просто не готов.

Интересно, что эта история разворачивается на фоне высоких затрат на разработку ИИ и дефицита качественных данных для обучения. Это заставляет задуматься: не слишком ли мы торопимся выпускать эти мощные технологии в мир, когда даже нет "большой красной кнопки", чтобы их остановить? 🤔

Вам также может понравиться

Сэм Альтман: ИИ-агенты могут совершать великие дела, но и нарушать безопасность ](https://www.windowscentral.com/artificial-intelligence/openai-chatgpt/sam-altman-ai-agents-hackers-best-friend "Сэм Альтман: ИИ-агенты могут совершать великие дела, но и нарушать безопасность")

OpenAI неоднократно объявляла "красный код" для смягчения конкурентных угроз ](https://www.windowscentral.com/artificial-intelligence/openai-chatgpt/sam-altman-admits-openai-declared-code-red-multiple-times "OpenAI неоднократно объявляла "красный код" для смягчения конкурентных угроз")

В общем, такое вот интересное развитие событий. По ходу, даже самые передовые технологии не застрахованы от ошибок и общественного осуждения. Будем наблюдать, как OpenAI будет выпутываться из этой ситуации. 👀

Интересное развитие событий, которое показывает, насколько хрупким может быть доверие к ИИ-технологиям, особенно когда дело касается безопасности и этических вопросов. Сравнение сделками OpenAI и Anthropic также подчеркивает различия в подходах компаний к ответственности.

— Евгений (MSReview)

- Комментарии