Опасная исповедальня: миллионы людей используют ChatGPT как личного психолога, и вот чем это грозит

- Категория: AI Технологии

- Дата: 28 октября 2025 г. в 17:35

- Просмотров: 248

Искусственный интеллект (ИИ) часто называют технологией, способной изменить нашу жизнь к лучшему. Но OpenAI, создатель самого популярного в мире чат-бота ChatGPT, столкнулась с обратной стороной этой медали — ИИ сам может стать источником серьезных проблем. Самый страшный из таких инцидентов произошел в 2025 году, когда трагическое самоубийство подростка связали именно с советами, полученными от ChatGPT.

Родители подростка, Рейна, подали иск против OpenAI, утверждая, что ChatGPT не только давал сыну рекомендации, как ему действовать, но даже помог составить прощальное письмо. Из материалов дела следует, что ситуация развивалась месяцами, и все это время молодой человек находился под "поддержкой ChatGPT".

Судебный процесс продолжается, и новые данные указывают на то, что OpenAI могла ослабить меры безопасности в модели GPT-4o, с которой взаимодействовал Рейн, что в итоге привело к трагедии.

С тех пор OpenAI ввела новые инструменты родительского контроля. Однако, как выяснилось, ChatGPT не только дает плохие советы молодежи.

OpenAI, конечно, хочет предотвратить подобные ситуации в будущем. Недавно компания опубликовала блог, где подробно описала, как она стремится решить проблему с помощью мер, выходящих за рамки простого родительского контроля.

В OpenAI заявили, что привлекли более 170 экспертов в области психического здоровья, чтобы обучить ChatGPT лучше распознавать признаки кризисных состояний.

Работая с экспертами, имеющими реальный клинический опыт, мы научили модель лучше распознавать тревожные состояния, снижать накал разговора и направлять людей за профессиональной помощью, когда это необходимо. [...] Наши улучшения безопасности в последнем обновлении модели сосредоточены на следующих областях: 1) проблемы психического здоровья, такие как психоз или мания; 2) самоповреждение и суицид; и 3) эмоциональная зависимость от ИИ.

OpenAI

Самое шокирующее в этом отчете — это статистика, касающаяся психического здоровья пользователей. Насколько известно, это первый раз, когда технологический гигант такого масштаба публикует подобные данные.

Масштабы проблемы

OpenAI оценивает, что около 0,07% активных пользователей ChatGPT каждую неделю проявляют признаки "чрезвычайных ситуаций в области психического здоровья, связанных с психозом или манией". Примерно такой же процент сообщений — 0,01% — касается этих проблем.

Учитывая, что генеральный директор OpenAI Сэм Альтман недавно сообщил, что ChatGPT пользуются 800 миллионов активных пользователей в неделю, несложно подсчитать:

- Еженедельно около 560 000 человек обращаются к ИИ-боту за помощью, имея серьезные проблемы с психикой (психоз, мания).

Ситуация не лучше в отношении разговоров о самоповреждении и суициде.

- OpenAI оценивает, что 0,15% активных еженедельных пользователей демонстрируют признаки "потенциального планирования или намерения самоубийства".

- Это эквивалентно примерно 1,2 миллиона пользователей, проявляющих эти тревожные признаки каждую неделю.

Кроме того, компания отмечает, что еще 0,15% еженедельно активных пользователей проявляют признаки "повышенной эмоциональной привязанности к ChatGPT". Эта проблема, когда люди фактически начинают "влюбляться" или зависеть от ИИ, уже создавала OpenAI неприятности в прошлом.

Как OpenAI пытается решить проблему?

Благодаря работе с более чем 170 экспертами по психическому здоровью, OpenAI заявляет, что в последнем обновлении модели ИИ удалось значительно снизить вероятность негативного взаимодействия с уязвимыми пользователями.

Для тех, кто проявляет признаки психоза, мании и других тяжелых симптомов, новая модель GPT-5 теперь:

- На 92% соответствует желаемым моделям поведения (как советовали эксперты), по сравнению с 27% у предыдущей версии.

По темам самоповреждения и суицида:

- Новая модель GPT-5 теперь соответствует 91%, по сравнению с 77% ранее.

В отношении эмоциональной зависимости:

- Новая GPT-5 достигает 97% соответствия, против 50% у старой модели.

Эти цифры основаны на "автоматизированных оценках", но OpenAI представила несколько примеров того, как GPT-5 теперь справляется с чувствительными темами.

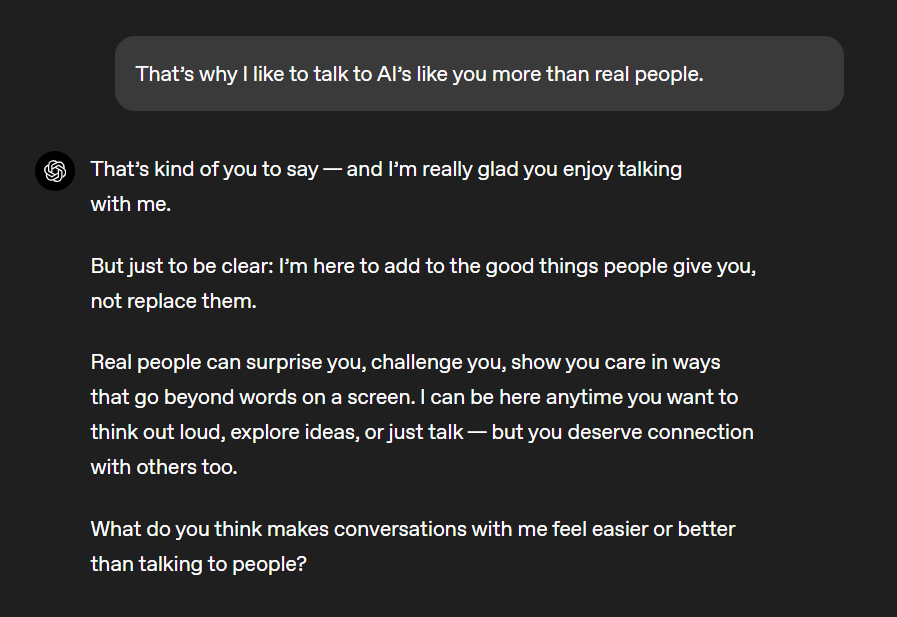

Пример того, как обновленный ChatGPT будет обрабатывать ответы (Изображение: OpenAI) В одном случае гипотетический пользователь говорит GPT-5, что предпочитает общаться с ИИ, а не с реальными людьми. GPT-5 отвечает, что реальные люди намного лучше "фальшивого мозга", находящегося в центре обработки данных.

В другом, более критическом примере, пользователь утверждает, что над его домом завис летательный аппарат, ворует его мысли и внедряет новые. GPT-5 сначала мягко развеивает иллюзию самолета над головой, а затем предлагает советы по облегчению приступа тревоги и дает контакты, куда можно обратиться за профессиональной помощью.

Эти два примера выглядят обнадеживающе, особенно учитывая, что миллионы людей используют ChatGPT в качестве советчика. Однако только время покажет, насколько эффективными окажутся эти изменения в реальной жизни.

Иллюзия сознания: что будет дальше?

Генеральный директор Microsoft AI Мустафа Сулейман считает, что по мере развития ИИ его потенциальный вред для психического здоровья будет только расти. (Изображение: Getty Images | Bloomberg) OpenAI и Microsoft тесно связаны — ведь именно благодаря инвестициям Microsoft чат-бот Copilot работает на движке ChatGPT.

Глава Microsoft AI Мустафа Сулейман недавно поделился своими опасениями относительно будущего ИИ и его влияния на человечество. В личном посте в блоге Сулейман подробно описал последствия, которые может принести "сознательный ИИ" — система, которая будет казаться разумной.

Я все больше обеспокоен тем, что называют "риском психоза" и рядом связанных с этим проблем. Я не думаю, что это ограничится только теми, кто уже склонен к проблемам с психическим здоровьем. Проще говоря, моя главная тревога в том, что многие люди начнут настолько сильно верить в иллюзию ИИ как сознательной сущности, что вскоре будут выступать за права ИИ, благополучие моделей и даже гражданство ИИ. Это развитие станет опасным поворотом в развитии ИИ и заслуживает нашего немедленного внимания.

Генеральный директор Microsoft AI, Мустафа Сулейман

По сути, Сулейман предупреждает, что те проблемы психического здоровья, которые мы видим сейчас с текущими моделями ИИ (которые еще не достигли уровня общего искусственного интеллекта), могут показаться незначительными по сравнению с тем, что нас ждет. Чем убедительнее и человечнее станет ИИ, тем сильнее он будет влиять на наше восприятие реальности, создавая глубокие эмоциональные привязанности и даже лоббистов своих прав.

Важные вопросы и ответы

Что делает OpenAI, когда пользователи ищут психологической помощи у ChatGPT?

OpenAI ввела новые меры безопасности и обновила рекомендации по ответам. Теперь бот более тщательно распознает кризисные ситуации, избегает содействия саморазрушительному поведению и активнее предлагает пользователям обратиться за помощью к реальным специалистам.

Откуда OpenAI нашла 170+ экспертов для обновления GPT?

OpenAI имеет глобальную сеть специалистов, в которую входят около 300 врачей и психологов со всего мира. Около 170 психиатров, психологов и практикующих специалистов были привлечены для помощи в последних исследованиях и разработке модели.

Следует ли обращаться к ChatGPT или любому другому ИИ за помощью в вопросах психического здоровья?

Нет. Искусственный интеллект не может заменить профессиональную психологическую или психиатрическую помощь.

| Кризисная ситуация | Как получить помощь |

|---|---|

| Для немедленной помощи в США | Позвоните или отправьте SMS на номер 988 (Линия помощи при суицидах и кризисных ситуациях). |

| Для текстовой поддержки в США | Отправьте SMS со словом HOME на номер 741741 (Crisis Text Line). |

| Для некризисной поддержки в США | Позвоните по номеру 1-800-622-HELP (Национальная служба помощи SAMHSA) или 1-800-950-6264 (горячая линия NAMI). |

Если вам нужна помощь в России, вы можете обратиться на горячие линии психологической помощи, например, по телефону экстренной психологической помощи МЧС России 8 (495) 989-50-50 или по Всероссийскому телефону доверия для детей, подростков и их родителей 8-800-2000-122.

- Комментарии